Răspunsuri Personalizate

Algoritmi antrenați pe datele tale specifice pentru soluții precise.

Poți construi chatbotul pentru suport clienți în câteva minute.

Crează AI Chatbot

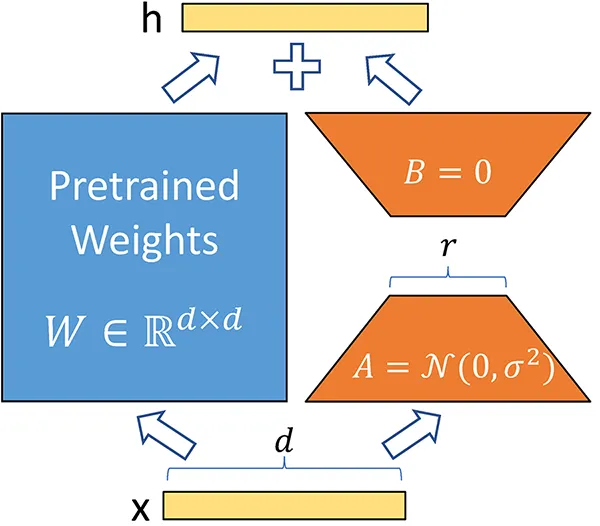

Acest articol explorează Adaptarea cu Rang Mic (LoRA), o tehnică transformatoare pentru ajustarea eficientă a modelelor mari de limbaj (LLM) precum GPT-4 și Stable Diffusion. Prin reducerea sarcinii computaționale a adaptării acestor modele, LoRA permite procese de antrenare mai rapide și mai rentabile. Vom acoperi principiile sale, avantajele și aplicațiile practice, precum și vom oferi un ghid de implementare practică folosind biblioteci Python.

Apple a dezvoltat modele de limbaj fundamentale pentru a îmbunătăți Apple Intelligence pe iOS, iPadOS și macOS. Aceste modele constau dintr-o versiune on-device cu 3 miliarde de parametri și o variantă mai puternică bazată pe server, ambele concepute pentru eficiență și versatilitate optimă. Procesul de antrenament implică pre-antrenament de bază pe 6.3 trilioane de token-uri, urmat de continuarea pre-antrenamentului cu lungimi de secvență mai mari și extinderea contextului. Pentru post-antrenament, se utilizează fine-tuning supervizat și învățare prin întărire din feedback-ul uman (RLHF), folosind tehnici avansate precum comitetul de predare iterativ (iTeC) și descendența prin oglindire cu estimarea leave-one-out (MDLOO). Modelele sunt specializate suplimentar folosind adaptoare LoRA, făcându-le bine adaptate pentru aplicații on-device. Rezultatele benchmark indică faptul că modelul AFM-on-device depășește modelele open-source mai mari, în timp ce modelul AFM-server concurează cu GPT-3.5. Ambele modele excelează în evaluările de siguranță, subliniind angajamentul Apple față de practici responsabile în domeniul AI.

Modelele Mari de Limbaj (LLMs) au revoluționat modul în care interacționăm cu tehnologia și au deschis noi căi pentru creativitate, eficiență și soluționarea problemelor. Cu toate acestea, ca orice instrument puternic, ele vin cu propriul set de avantaje și dezavantaje. Înțelegerea acestor aspecte este esențială pentru navigarea implementării lor în diverse domenii.

Modelul Gemma 2 2B, o adăugire foarte așteptată la gama Gemma 2, este acum disponibil. Acest model ușor obține rezultate remarcabile printr-un proces numit distilare, în care învață din modele mai mari. În ciuda dimensiunii sale mai mici, Gemma 2 2B depășește toate modelele GPT-3.5 pe Chatbot Arena, demonstrând capabilitățile sale excepționale în AI conversațional.

Răspunsuri Personalizate

Algoritmi antrenați pe datele tale specifice pentru soluții precise.

Disponibilitate

Asistență 24/7 cu răspunsuri instantanee. Toți utilizatorii vor experimenta un agent similar unui om, disponibil pentru nevoile lor.

Performanță

Oferim performanța celor mai bune modele GenAI de la OpenAI, adaptate la datele tale.

Scalabilitate

Poți conversa în paralel cu un număr mult mai mare de utilizatori și să câștigi clienți.

Suport Multi-limbă

Agenții GenAI pot comunica fără probleme în orice limbă, chiar dacă datele lor sunt într-o altă limbă.

Integrare Ușoară

Agenții GenAI pot fi integrați cu orice aplicație web.

Poți construi chatbotul pentru suport clienți în câteva minute.

Crează un asistent personalizat